chatglm

描述

智谱大模型GLM-4

智谱 AI 开放平台提供一系列具有不同功能和定价的大模型,包括通用大模型、超拟人大模型、图像大模型、向量大模型等,并且支持使用您的私有数据对模型进行微调。

关于

介绍

智谱 AI 开放平台提供一系列具有不同功能和定价的大模型,包括通用大模型、超拟人大模型、图像大模型、向量大模型等,并且支持使用您的私有数据对模型进行微调。

2024年01月16日,我们在「智谱AI技术开放日(ZHIPU DevDay)」推出新一代基座大模型 GLM-4。

资源

关键概念

GLM

GLM 全名 General Language Model ,是一款基于自回归填空的预训练语言模型。ChatGLM系列模型,支持相对复杂的自然语言指令,并且能够解决困难的推理类问题。该模型配备了易于使用的 API 接口,允许开发者轻松将其融入各类应用,广泛应用于智能客服、虚拟主播、聊天机器人等诸多领域。

Embedding

Embedding 是一种将数据(如文本)转化为向量形式的表示方法,这种表示方式确保了在某些特定方面相似的数据在向量空间中彼此接近,而与之不相关的数据则相距较远。通过将文本字符串转换为向量,使得数据能够有效用于搜索、聚类、推荐系统、异常检测和分类等应用场景。

Token

Token 是模型用来表示自然语言文本的基本单位,可以直观的理解为“字”或“词”;通常 1 个中文词语、1 个英文单词、1 个数字或 1 个符号计为 1 个token。

一般情况下 ChatGLM 系列模型中 token 和字数的换算比例约为 1:1.6 ,但因为不同模型的分词不同,所以换算比例也存在差异,每一次实际处理 token 数量以模型返回为准,您可以从返回结果的 usage 中查看。

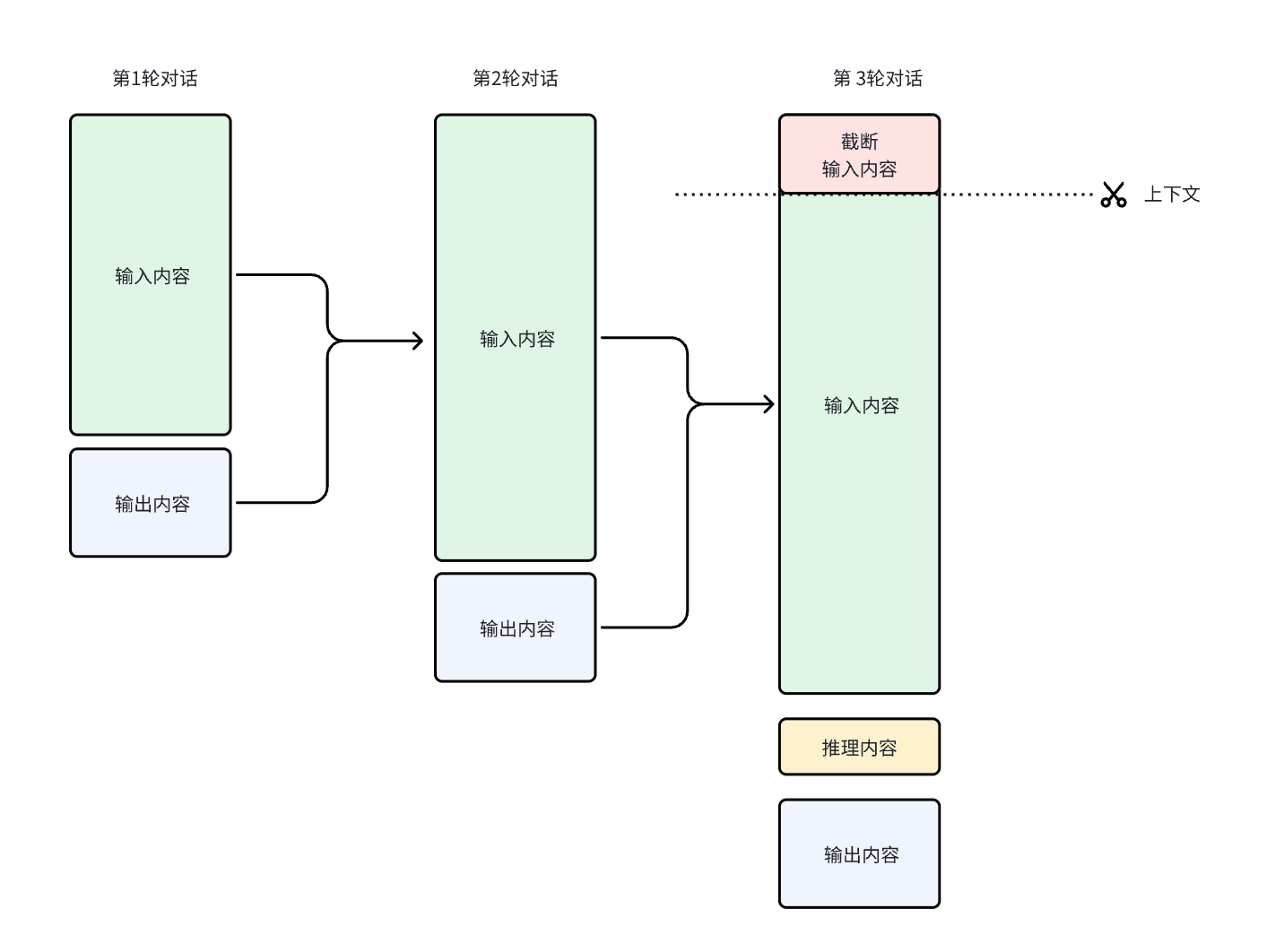

上下文

上下文窗口是指模型在一次对话中能够处理的最大长度。包括:

- 用户输入的内容

- 模型生成的回复

- 模型在生成回复过程中进行推理或调用工具时产生的中间内容(如:GLM-4-AllTools )

如果超出上下文窗口限制,会发生什么?

- 超出部分被截断:如果总文本量超过了上下文窗口的限制,超出的部分将被自动丢弃,无法被处理。

- 影响对话内容:你可能看不到被丢弃的部分,从而影响模型的回答质量或上下文的连贯性。

查看模型的上下文限制,或者使用 Tokenizer 工具 估算上下文长度。

注意:以上内容仅适用于GLM-4系列语言模型。对于多模态模型,输入内容有严格长度限制,若超出限制,系统将提示“prompt超长”。